为什么心智的统一性来自大脑整体结构,而不是某个单一脑区

为什么在某一个认知领域表现出色的人,往往在所有领域都表现出色?一个多世纪以来,上述模式始终困扰着科学家。一代又一代的神经影像研究不断揭示出各类扫描图像,突出额叶、顶叶皮层以及那些被视为认知能力枢纽的特定网络。然而,至今尚无研究能真正解释,为何智能表现得像心智的统一属性,而非一堆孤立技能。

来自圣母大学(University of Notre Dame)的一项新研究给出了一个令人信服的答案。关键不在于任何一个特定的脑区,而在于整个大脑的组织方式。这项由 Aron Barbey 教授和第一作者 Ramsey Wilcox 领导的研究,于2026年1月发表在《Nature Communications》上。他们测试了网络神经科学理论(Network Neuroscience Theory)的四个具体预测,分析了人类连接组计划(Human Connectome Project)中831名成年人的脑成像数据,并结合一个独立的145名成人样本进行验证。他们的发现重新理解了智能的本质:智能是大脑系统本身的属性,源于大脑网络间高效、灵活且高度一致的协作。 我们采访了该研究的博士生兼第一作者 Ramsey Wilcox,探讨了将核心命题从“智能何在?”转向“大脑如何组织?”的深远意义,并解析了此类转变所揭示的心智本质。

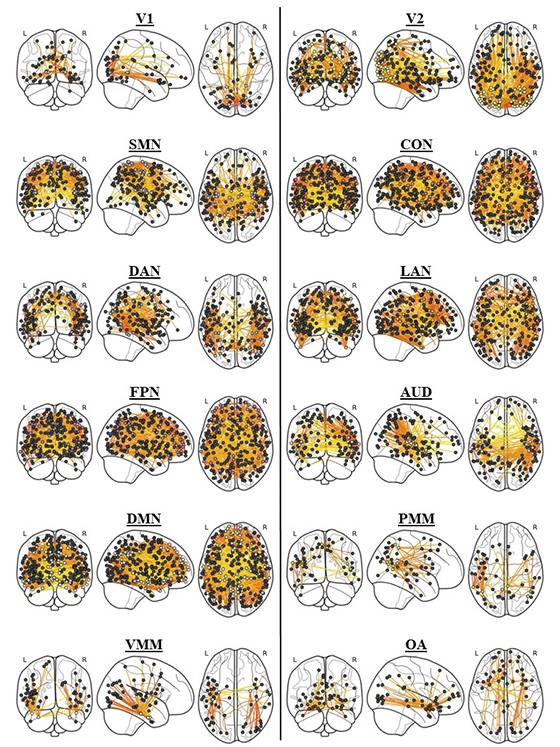

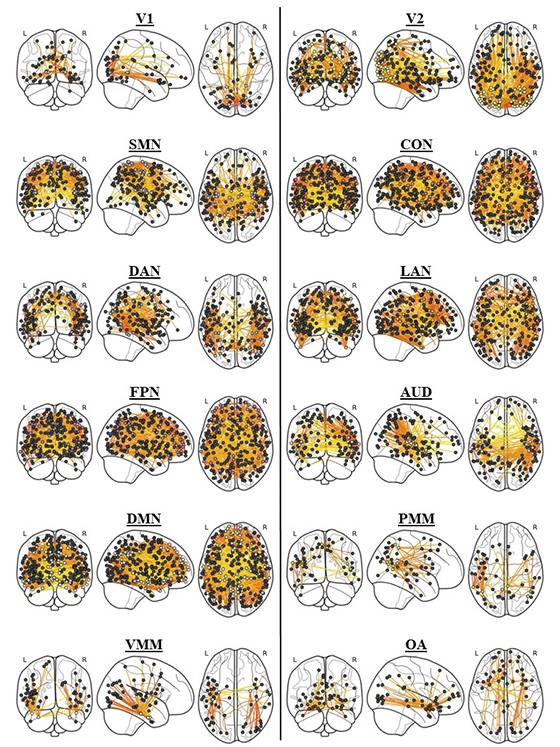

Image credit: Decision Neuroscience Laboratory, University of Notre Dame.

对话

定位技术确实提供了海量信息,使研究者能清晰识别运动、视觉、注意力和认知控制等基本功能背后的关键脑区。然而,解决现实复杂难题等智能行为,并非某种“纯粹”的单一认知操作,其本质依赖于大量不同要素间高度协调的系统整合。

解决复杂的数学题便是典型案例:视觉系统读取数字,工作记忆留存信息,长期记忆调取规则,执行功能则编排解题步骤。没有任何单一脑区能独自完成上述流程。因此,核心在于探究各功能区域间的协作机制。这些区域虽各司其职,却必须高度整合,方能达成复杂且精细的任务。

上述协作很大程度上取决于大脑整体架构。此类全局结构几乎影响所有认知过程,最终形成所谓的“正相关流形”(positive manifold)。若研究仅聚焦于局部定位,便极易忽略整合层面的关键维度,陷入只见树木、不见森林的困境。

传统的神经影像分析主要聚焦于定位:研究者在扫描中让参与者完成某项任务,然后看看哪些脑区的激活水平最高,就据此推断这些区域对该认知操作有多重要。

但现在,研究领域越来越清楚地认识到,没有任何一个脑区是真正孤立运作的。从生物学上看,大脑是一个高度互联的复杂系统。不同皮层区域通过长距离的白质通路相互连接,让信息能够快速传播。正是因为这种高度整合,高阶认知功能几乎不可能局限在某个孤立的脑区里。相反,它们来自于广泛分布的网络之间的协同活动,而这些网络又受到大脑整体架构的深刻塑造。复杂认知对这种整体结构的依赖,正是"正相关流形"出现的主要原因。

因此,当我们把问题转向"系统是如何组织"时,就会开始采用基于网络和拓扑结构的测量工具,很多都借助图论来进行分析。研究者不再只看局部激活的强度,而是去测量网络效率、小世界特性等全局属性。这种测量方式的转变,从根本上改变了我们对数据的理解:它不仅能告诉我们活动发生在哪儿,还能揭示大脑的结构和功能是如何整合信息,以及这种内在组织如何支撑复杂、动态的认知状态。

谈到效率时,我们指的是网络内部连接方式的组织结构。更具体地说,就是信息在网络中传播的难易程度——信号从一个脑区传递到另一个脑区,需要经过多复杂的路径。想象一种理想的网络:如果所有节点都直接相连,效率当然极高,因为信号只需一步就能到达。但真实大脑没法承受这种"全连接"带来的巨大代谢成本。所以大脑采用了一种叫"小世界网络"(small-world network)的结构,既保持了较高的信息传递效率,又能有效组织整个系统的信息流动。我们通常通过计算特征路径长度(characteristic path length)来量化效率,也就是所有节点之间最短路径的平均连接数。路径越短,网络就越高效。

灵活性则更复杂一些。广义上,我把灵活性理解为:大脑的结构架构在多大程度上既限制又促进不同功能状态之间的快速转换。网络神经科学里有一个很令人兴奋的方向,就是用网络控制理论(network control theory)来解释这个关系。其中一部分工作会量化从一种神经活动模式切换到另一种模式所需的能量成本,而这个成本取决于结构拓扑对系统的约束。通过测量这种转换需要的能量,我们就能评估灵活性。如果大脑在不同认知状态间切换的能量成本更低,我们就说它更灵活。

如果非要挑一个,我会说分布式处理最有挑战性,因为它直接碰上了典型的"大数据"难题。可测量的脑连接数量远远超过我们能招募的参与者数量。在统计上,这叫"p大于n问题",特征维度比样本量还大。传统回归模型很难收敛,因为数据不够支持模型求解。所以我们得借助机器学习方法。正则化技术可以对连接特征施加惩罚或筛选,让模型收敛。但这也要求非常仔细地调超参数,因为这些参数会显著影响模型表现。

机器学习模型很强大,它们能在数据里挖出任何跟结果相关的模式。难点在于分辨这些模式是样本特有的(过拟合),还是能推广到新数据。所以我们必须用严格的交叉验证,确保模型在独立样本上也有效。

至于意外发现,因为我们的研究是基于明确理论预测,而不是纯探索性研究,所以传统意义上并没有特别"惊讶"的结果。我们对这些预测会得到支持本来就很有信心。不过,当分析结果真的按预期一一展开时,那种兴奋感还是很强烈的。

很可能三者都有份。首先,从枢纽区域发出的解剖连接本身就天然限制并影响它连接的其他脑区。同时,大脑会随着经验不断重塑。过去学习的内容会在结构上留下物理痕迹,通过神经可塑性改变连接的相对强度。

想象你学一款复杂的电脑游戏:一开始掌握规则需要大量认知努力,但练熟后,这些操作就变得越来越自动化。可以说,网络已经根据你的经验进行了优化。

此外,这还是一个高度动态、情境依赖的过程。调节枢纽不会固定只连某几组区域,而是根据当前任务需求调整通信策略。比如前顶叶控制网络里的枢纽:当你向内回忆过去经历时,它们会加强与默认模式网络的沟通;当你需要专注外界刺激时,又会迅速增强与背侧注意网络的联系。

执行控制是一种具体的认知功能,而系统层面的协调指的是大脑连接的内在组织方式,它为认知过程的展开创造了条件。小世界结构会在系统中形成模块(子网络),这些模块可以独立完成基本的神经操作。同时,这些模块又不是完全孤立的。它们之间会相互通信,把基础操作整合起来,支持更高层次的认知。

关键在于,我们讨论的不是认知本身(也就是信息处理活动),而是让各种信息处理得以发生的结构条件。换句话说,这是一种基础架构,一种在不同情境下约束和支撑神经活动执行认知的框架。

打个比方,就像房子里的水管系统:水管的布局和结构决定了水能流到哪些房间、什么时候能供水。但水管本身不会"推动"水流。真正控制水流方向和流量的,是开水龙头的那只手,这更像执行功能。水管系统决定了可能的路径,而水龙头决定了实际发生的水流。

大脑的整体拓扑结构确实在一般智能的个体差异中起着重要作用。如果我们把一般学习能力看作快速吸收并整合来自不同领域的新信息,那么拥有高效率、高灵活性系统结构的人,自然更容易适应新的认知需求。

但必须强调,这些是相关性研究,不能直接推因果。另外,在其他生物学层面也可能有其他因素。比如分子层面,白质纤维的微观结构完整性(髓鞘化程度)、代谢效率等,很多研究都证明它们跟认知表现有关。

这些层面不是互相独立的。很可能低层级的生物特征之所以影响认知,正是因为它们塑造并支撑了我们在系统层面看到的这些网络属性。

结语

Wilcox 与他的同事所做的工作,远不止于脑成像技术的一次进步。他们真正做到的,是提出了一种重新审视古老问题的思路,从而彻底重新定义了"智能"的本质。

在此视角下,智能并非储存在某个特定位置的实体。它不是某个脑区、不是单一网络,也不是某个模块,而是一种涌现属性:当大脑中众多专业化的子系统能够高效沟通、在不同功能状态之间灵活切换,同时兼顾局部精细操作与全脑整体协调时,智能便自然而然地显现出来。从某种意义上讲,那是一种结构上的成就。

上述发现的影响延伸到多个领域。对于神经科学,它提供了解释:为什么智能会随着生命历程呈现出可预测的轨迹——儿童期整体提升、衰老过程中逐渐下降,并且对弥散性脑损伤格外敏感。关键在于,其中改变的不是某个单一功能,而是大尺度协调能力。

对于人工智能研究,此项工作也提出了一个值得深思的问题:如果人类的通用智能源于系统层面的组织结构,而非某种专属的"通用处理器",那么仅仅通过扩大特定能力的规模,或许还不足以让机器真正具备通用智能。

而对我们每个人来说,其中有一种安静却深刻的启示:心智真正的力量,并不来自任何单一部分的出色,而是所有部分以优雅方式协同工作的整体结构。

为什么心智的统一性来自大脑整体结构,而不是某个单一脑区

为什么在某一个认知领域表现出色的人,往往在所有领域都表现出色?一个多世纪以来,上述模式始终困扰着科学家。一代又一代的神经影像研究不断揭示出各类扫描图像,突出额叶、顶叶皮层以及那些被视为认知能力枢纽的特定网络。然而,至今尚无研究能真正解释,为何智能表现得像心智的统一属性,而非一堆孤立技能。

来自圣母大学(University of Notre Dame)的一项新研究给出了一个令人信服的答案。关键不在于任何一个特定的脑区,而在于整个大脑的组织方式。这项由 Aron Barbey 教授和第一作者 Ramsey Wilcox 领导的研究,于2026年1月发表在《Nature Communications》上。他们测试了网络神经科学理论(Network Neuroscience Theory)的四个具体预测,分析了人类连接组计划(Human Connectome Project)中831名成年人的脑成像数据,并结合一个独立的145名成人样本进行验证。他们的发现重新理解了智能的本质:智能是大脑系统本身的属性,源于大脑网络间高效、灵活且高度一致的协作。 我们采访了该研究的博士生兼第一作者 Ramsey Wilcox,探讨了将核心命题从“智能何在?”转向“大脑如何组织?”的深远意义,并解析了此类转变所揭示的心智本质。

Image credit: Decision Neuroscience Laboratory, University of Notre Dame.

对话

定位技术确实提供了海量信息,使研究者能清晰识别运动、视觉、注意力和认知控制等基本功能背后的关键脑区。然而,解决现实复杂难题等智能行为,并非某种“纯粹”的单一认知操作,其本质依赖于大量不同要素间高度协调的系统整合。

解决复杂的数学题便是典型案例:视觉系统读取数字,工作记忆留存信息,长期记忆调取规则,执行功能则编排解题步骤。没有任何单一脑区能独自完成上述流程。因此,核心在于探究各功能区域间的协作机制。这些区域虽各司其职,却必须高度整合,方能达成复杂且精细的任务。

上述协作很大程度上取决于大脑整体架构。此类全局结构几乎影响所有认知过程,最终形成所谓的“正相关流形”(positive manifold)。若研究仅聚焦于局部定位,便极易忽略整合层面的关键维度,陷入只见树木、不见森林的困境。

传统的神经影像分析主要聚焦于定位:研究者在扫描中让参与者完成某项任务,然后看看哪些脑区的激活水平最高,就据此推断这些区域对该认知操作有多重要。

但现在,研究领域越来越清楚地认识到,没有任何一个脑区是真正孤立运作的。从生物学上看,大脑是一个高度互联的复杂系统。不同皮层区域通过长距离的白质通路相互连接,让信息能够快速传播。正是因为这种高度整合,高阶认知功能几乎不可能局限在某个孤立的脑区里。相反,它们来自于广泛分布的网络之间的协同活动,而这些网络又受到大脑整体架构的深刻塑造。复杂认知对这种整体结构的依赖,正是"正相关流形"出现的主要原因。

因此,当我们把问题转向"系统是如何组织"时,就会开始采用基于网络和拓扑结构的测量工具,很多都借助图论来进行分析。研究者不再只看局部激活的强度,而是去测量网络效率、小世界特性等全局属性。这种测量方式的转变,从根本上改变了我们对数据的理解:它不仅能告诉我们活动发生在哪儿,还能揭示大脑的结构和功能是如何整合信息,以及这种内在组织如何支撑复杂、动态的认知状态。

谈到效率时,我们指的是网络内部连接方式的组织结构。更具体地说,就是信息在网络中传播的难易程度——信号从一个脑区传递到另一个脑区,需要经过多复杂的路径。想象一种理想的网络:如果所有节点都直接相连,效率当然极高,因为信号只需一步就能到达。但真实大脑没法承受这种"全连接"带来的巨大代谢成本。所以大脑采用了一种叫"小世界网络"(small-world network)的结构,既保持了较高的信息传递效率,又能有效组织整个系统的信息流动。我们通常通过计算特征路径长度(characteristic path length)来量化效率,也就是所有节点之间最短路径的平均连接数。路径越短,网络就越高效。

灵活性则更复杂一些。广义上,我把灵活性理解为:大脑的结构架构在多大程度上既限制又促进不同功能状态之间的快速转换。网络神经科学里有一个很令人兴奋的方向,就是用网络控制理论(network control theory)来解释这个关系。其中一部分工作会量化从一种神经活动模式切换到另一种模式所需的能量成本,而这个成本取决于结构拓扑对系统的约束。通过测量这种转换需要的能量,我们就能评估灵活性。如果大脑在不同认知状态间切换的能量成本更低,我们就说它更灵活。

如果非要挑一个,我会说分布式处理最有挑战性,因为它直接碰上了典型的"大数据"难题。可测量的脑连接数量远远超过我们能招募的参与者数量。在统计上,这叫"p大于n问题",特征维度比样本量还大。传统回归模型很难收敛,因为数据不够支持模型求解。所以我们得借助机器学习方法。正则化技术可以对连接特征施加惩罚或筛选,让模型收敛。但这也要求非常仔细地调超参数,因为这些参数会显著影响模型表现。

机器学习模型很强大,它们能在数据里挖出任何跟结果相关的模式。难点在于分辨这些模式是样本特有的(过拟合),还是能推广到新数据。所以我们必须用严格的交叉验证,确保模型在独立样本上也有效。

至于意外发现,因为我们的研究是基于明确理论预测,而不是纯探索性研究,所以传统意义上并没有特别"惊讶"的结果。我们对这些预测会得到支持本来就很有信心。不过,当分析结果真的按预期一一展开时,那种兴奋感还是很强烈的。

很可能三者都有份。首先,从枢纽区域发出的解剖连接本身就天然限制并影响它连接的其他脑区。同时,大脑会随着经验不断重塑。过去学习的内容会在结构上留下物理痕迹,通过神经可塑性改变连接的相对强度。

想象你学一款复杂的电脑游戏:一开始掌握规则需要大量认知努力,但练熟后,这些操作就变得越来越自动化。可以说,网络已经根据你的经验进行了优化。

此外,这还是一个高度动态、情境依赖的过程。调节枢纽不会固定只连某几组区域,而是根据当前任务需求调整通信策略。比如前顶叶控制网络里的枢纽:当你向内回忆过去经历时,它们会加强与默认模式网络的沟通;当你需要专注外界刺激时,又会迅速增强与背侧注意网络的联系。

执行控制是一种具体的认知功能,而系统层面的协调指的是大脑连接的内在组织方式,它为认知过程的展开创造了条件。小世界结构会在系统中形成模块(子网络),这些模块可以独立完成基本的神经操作。同时,这些模块又不是完全孤立的。它们之间会相互通信,把基础操作整合起来,支持更高层次的认知。

关键在于,我们讨论的不是认知本身(也就是信息处理活动),而是让各种信息处理得以发生的结构条件。换句话说,这是一种基础架构,一种在不同情境下约束和支撑神经活动执行认知的框架。

打个比方,就像房子里的水管系统:水管的布局和结构决定了水能流到哪些房间、什么时候能供水。但水管本身不会"推动"水流。真正控制水流方向和流量的,是开水龙头的那只手,这更像执行功能。水管系统决定了可能的路径,而水龙头决定了实际发生的水流。

大脑的整体拓扑结构确实在一般智能的个体差异中起着重要作用。如果我们把一般学习能力看作快速吸收并整合来自不同领域的新信息,那么拥有高效率、高灵活性系统结构的人,自然更容易适应新的认知需求。

但必须强调,这些是相关性研究,不能直接推因果。另外,在其他生物学层面也可能有其他因素。比如分子层面,白质纤维的微观结构完整性(髓鞘化程度)、代谢效率等,很多研究都证明它们跟认知表现有关。

这些层面不是互相独立的。很可能低层级的生物特征之所以影响认知,正是因为它们塑造并支撑了我们在系统层面看到的这些网络属性。

结语

Wilcox 与他的同事所做的工作,远不止于脑成像技术的一次进步。他们真正做到的,是提出了一种重新审视古老问题的思路,从而彻底重新定义了"智能"的本质。

在此视角下,智能并非储存在某个特定位置的实体。它不是某个脑区、不是单一网络,也不是某个模块,而是一种涌现属性:当大脑中众多专业化的子系统能够高效沟通、在不同功能状态之间灵活切换,同时兼顾局部精细操作与全脑整体协调时,智能便自然而然地显现出来。从某种意义上讲,那是一种结构上的成就。

上述发现的影响延伸到多个领域。对于神经科学,它提供了解释:为什么智能会随着生命历程呈现出可预测的轨迹——儿童期整体提升、衰老过程中逐渐下降,并且对弥散性脑损伤格外敏感。关键在于,其中改变的不是某个单一功能,而是大尺度协调能力。

对于人工智能研究,此项工作也提出了一个值得深思的问题:如果人类的通用智能源于系统层面的组织结构,而非某种专属的"通用处理器",那么仅仅通过扩大特定能力的规模,或许还不足以让机器真正具备通用智能。

而对我们每个人来说,其中有一种安静却深刻的启示:心智真正的力量,并不来自任何单一部分的出色,而是所有部分以优雅方式协同工作的整体结构。